SkillStack Lab (Skista) 運営者のスタックです。

最近、バックオフィス業務のDXや効率化を目指して生成AIを導入する企業が急激に増えていますが、現場から悲鳴としてよく聞こえてくるのがGPT-5の制限に関する強烈な悩みですね。

特に無料プランや標準的な有料プランで利用していると、いざという重要な作業のタイミングに限って利用回数の上限に達してしまい、作業が完全にストップしてしまう事態が頻発しています。

私自身、中小企業で管理部門の責任者を務めつつ、元情シスの目線で社内システム全体を見渡していると、この制限が単なる「ツールの不便さ」にとどまらず、思わぬセキュリティ事故を引き起こす引き金になっていると感じて止みません。

今回は、現場のリアルな実態とトラブル事例を交えながら、この厄介な問題の仕様と、業務を止めないための抜本的な対策について深掘りしていこうかなと思います。

- GPT-5で発生するメッセージ数や時間制限の具体的な仕組みと実態

- 添付ファイルの処理時にエラーが頻発してしまう技術的な背景

- 制限に引っかかった現場社員が陥るシャドーITと情報漏洩の危険性

- 場当たり的な回避策ではなく根本的に業務を止めないためのSaaS運用戦略

業務を止めるGPT-5の制限と基本仕様

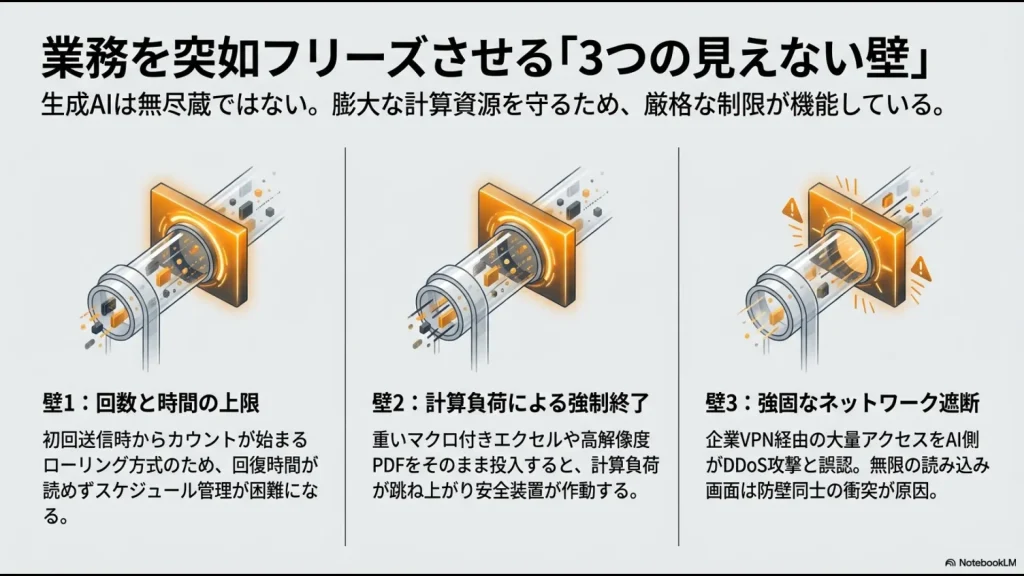

最新のAIモデルは驚異的な推論能力を持っていますが、その裏側では膨大な計算リソースを消費しているため、ユーザーに対して厳格な利用制限が設けられています。

ここでは、現場の業務を突然フリーズさせる「見えない壁」の正体について詳しく解説していきます。

メッセージ数と時間の上限とは

GPT-5を業務でフル活用しようとした際、最初にぶち当たる最大の壁がこのメッセージ送信数の上限ですね。

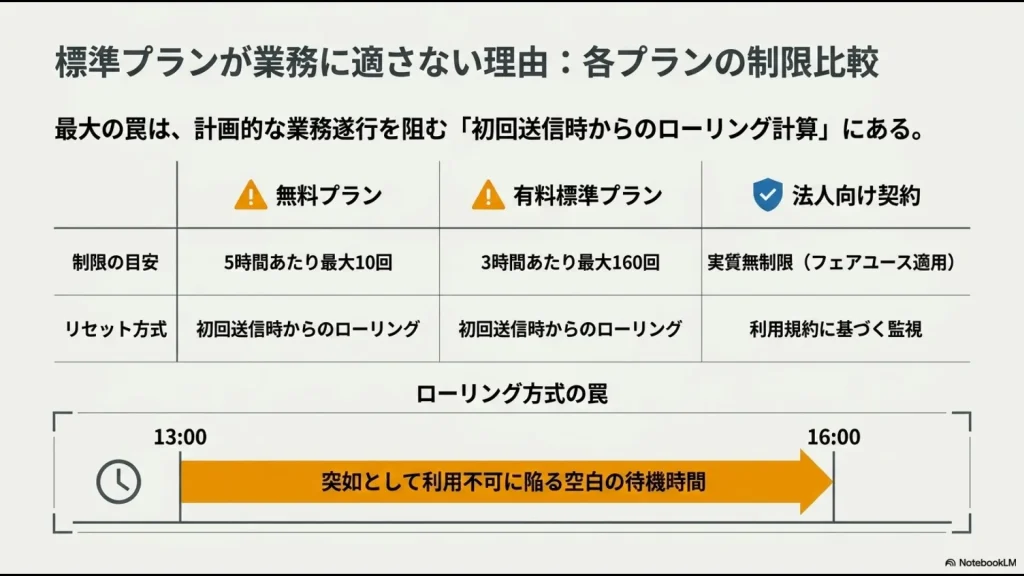

無料プランであれば「5時間あたり最大10回」、有料のPlusプランであっても「3時間あたり160回」といった具合に、明確なキャップが設定されています。

しかもこの制限は「毎日深夜0時にリセット」という分かりやすいものではなく、最初にメッセージを送った瞬間からカウントダウンが始まる「ローリングウィンドウ方式」という非常に厄介な仕様になっています。

皆さんも経験があるのではないでしょうか。急ぎの稟議書をまとめている最中に『利用上限に達しました』という非情なメッセージが出て業務が完全にストップする絶望感。

経営陣から「今日の15時までにこのデータを分析しておいて」と頼まれ、必死にプロンプトを試行錯誤している最中にAIが沈黙してしまうと、頭の中まで真っ白になりますよね。

元情シスの視点から言わせてもらえば、インフラの保護としては正しい仕様なのですが、ユーザー側からすると「いつ回復するのか正確な時間が読めない」という点が、業務計画を立てる上で致命的なボトルネックになってしまうかなと思います。

以下の表は、各プランにおける制限の目安をまとめたものです。業務で本格利用する場合は、この仕様を前提としたスケジュール管理が求められます。

| プランの種類 | 制限の目安(標準モデル) | リセット方式の仕組み |

|---|---|---|

| 無料 (Free) プラン | 5時間あたり最大10回 | 初回送信時からのローリング |

| Plus / Go プラン | 3時間あたり最大160回 | 初回送信時からのローリング |

| Business / Pro | 実質無制限(フェアユース適用) | 利用規約に基づく監視 |

添付ファイル容量でエラーになる理由

大量のPDFマニュアルや、複雑な財務データが入力されたエクセルファイルを読み込ませて一気に要約させようとした際、突然エラーを吐き出されて処理が止まってしまうことも頻発します。

GPT-5は最大400Kトークンという非常に広大な情報を一度に処理できるポテンシャルを持っていますが、だからといって無制限に重いファイルを投げ込めるわけではありません。

AIのシステムは、ユーザーからアップロードされた未知の巨大ファイルを処理する際、セキュリティチェックを含めて非常に慎重なプロセスを踏んでいます。

一度に極端に重いデータを解析させようとすると、サーバー側のコンピュート負荷が跳ね上がり、システム全体を保護するためのフェイルセーフが作動して強制終了させられてしまうのです。

例えば、マクロが大量に組み込まれた数十シートに及ぶ経営企画のエクセルや、高解像度の画像が多数埋め込まれたスライド資料などをそのままアップロードすると、見た目のファイルサイズ以上にAI側の処理カロリーが高くなります。

その結果として「解析に失敗しました」というエラーが返され、現場で「AIが固まった!」とパニックになる最大の要因となっているのです。

重いデータはテキスト形式(CSVなど)に変換するか、ファイルを分割してアップロードするなどの事前準備が不可欠ですね。

なぜすぐ使えない状態になるのか

利用回数の上限に達していないはずなのに、ログインすらできなくなったり、画面が真っ白になって使えなくなったりする現象も、GPT-5の制限の別の一面です。

これは主にネットワーク環境やセキュリティの壁に弾かれていることが原因ですね。 企業内のネットワーク環境では、セキュリティ対策としてプロキシやVPNを経由してインターネットに接続することが一般的です。

しかし、AI側のシステムはこうした「複数のユーザーが同じIPアドレスから大量にアクセスしてくる状態」を、ボットによるDDoS攻撃や不正なデータスクレイピングとみなして自動的に遮断するガードレールを強固に敷いています。

Cloudflareの「ブラウザの確認中」という画面から一生先に進まなくなる無限ループ現象は、まさにこのセキュリティ検知に引っかかっている確固たる証拠です。

現場の担当者から「AIが壊れました!何も表示されません!」と情シスに駆け込んでくるクレームの大半は、実はAIの故障ではなく、自社の強固すぎるネットワーク制限とAI側の防壁が真っ向から衝突していることに起因しているケースがほとんどかなと思います。

制限回避の裏技は本当に有効か

制限に引っかかった際、ネットで検索すると「ブラウザのキャッシュを全削除すればいい」「シークレットモードを使えば回数がリセットされる」「無料のVPNツールで海外のIPアドレスに偽装すれば回避できる」といった怪しげな裏技がたくさん出てきます。

しかし、結論から言うと、これらを企業の業務環境で試すのは絶対にやめておくべきです。

特に、部署内で一つの有料アカウントを複数人で使い回すような行為は明確な規約違反にあたります。

悪質なアクセスだと判定されれば、最悪の場合は企業ドメイン全体のIPがブラックリスト入りし、社内の誰もAIにアクセスできなくなるリスクすらあります。

業務を止めないために裏技に頼るという発想自体が、ガバナンスの観点から非常に危険だということを、管理部門としては現場に強くアナウンスしておく必要がありますね。

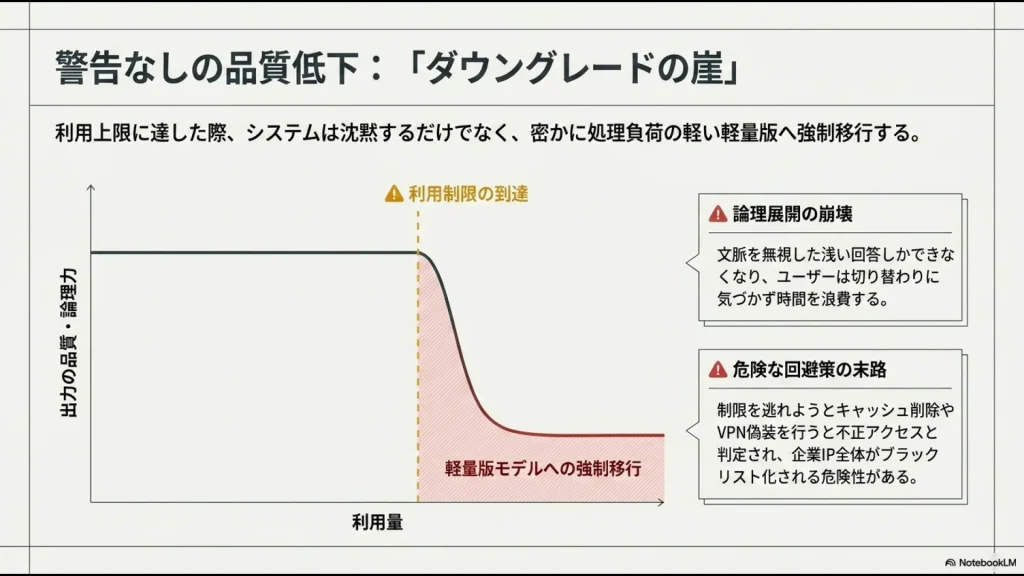

突然のダウングレードが招く悲劇

GPT-5の利用制限に達した際、システムはただ沈黙するだけでなく、処理負荷の軽い「miniモデル(軽量版)」へと強制的にダウングレードさせる仕様になっています。

実はこれが、現場に最も大きな混乱と品質低下をもたらす原因だったりします。

それまで極めて高い知能で複雑な契約書のリーガルチェックや、難解なエクセルマクロのデバッグを完璧な論理展開でこなしていたAIが、制限を超えた瞬間に「表面的な浅い回答」や「文脈を無視したトンチンカンな出力」しかできなくなってしまうのです。

ユーザー側はモデルが切り替わったことに気づかず、「あれ?急にAIが馬鹿になった?」と勘違いして、何度も同じ質問を繰り返してさらに時間を浪費してしまいます。

高度な論理的推論を必要とするタスクの途中で強制ダウングレードが発生すると、それまで積み上げてきた前提条件の文脈が完全に崩壊し、出力されるデータの品質が業務では使えないレベルへと劣化してしまいます。

誤った情報をそのまま資料に転記してしまう危険性もあり、これが業務品質に直結する大きな悲劇ですね。

GPT-5の制限が引き起こす情報漏洩の罠

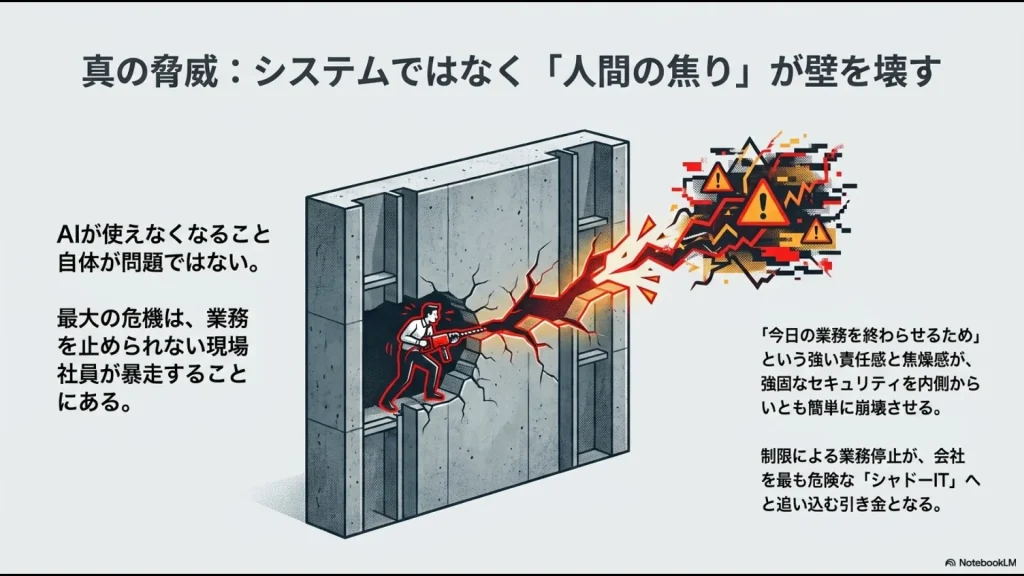

ここまで、システム的な仕様面について解説してきましたが、私のような管理部門の責任者や元情シスという立場からすると、本当に恐ろしいのはAIが「使えなくなること」そのものではありません。

突如として業務がストップした際に、現場で一体何が起きるのか。ここでは、システム制限が生み出す見えないセキュリティの落とし穴について深く掘り下げていこうかなと思います。

焦る社員が陥るシャドーITの恐怖

現場の社員は日々、膨大なタスクと厳しい締め切りに追われています。そんな中、業務効率化の切り札として頼っていたAIが、利用回数の上限によって急に「数時間待ってください」と沈黙してしまったらどうなるでしょうか。

大半の社員は、決して悪意があってルールを破るわけではありません。

「今日の業務を終わらせるために、なんとか別の方法を見つけなければ」という強い責任感と焦りから、個人のスマホや会社のPCで「無料 AI 制限なし」などと検索し、会社の管理外である正体不明のWebサービスに手を出してしまうのです。

これこそが、私たちが最も恐れるシャドーITの実態ですね。会社が許可していないツールに、顧客の個人情報や社内の機密データがコピー&ペーストされてしまう。

ファイアウォールでどれだけガチガチに防御を固めていても、社員の「急いで仕事を終わらせたい」という焦りが、いとも簡単にセキュリティの壁を内側から崩壊させてしまうのです。

こうしたシャドーITやAIの不適切な業務利用による情報漏洩リスクは、(出典:IPA 独立行政法人 情報処理推進機構『情報セキュリティ10大脅威 2026』)にも組織向けの新たな脅威として選出されるほど、現代の企業にとって無視できない極めて深刻な問題となっています。

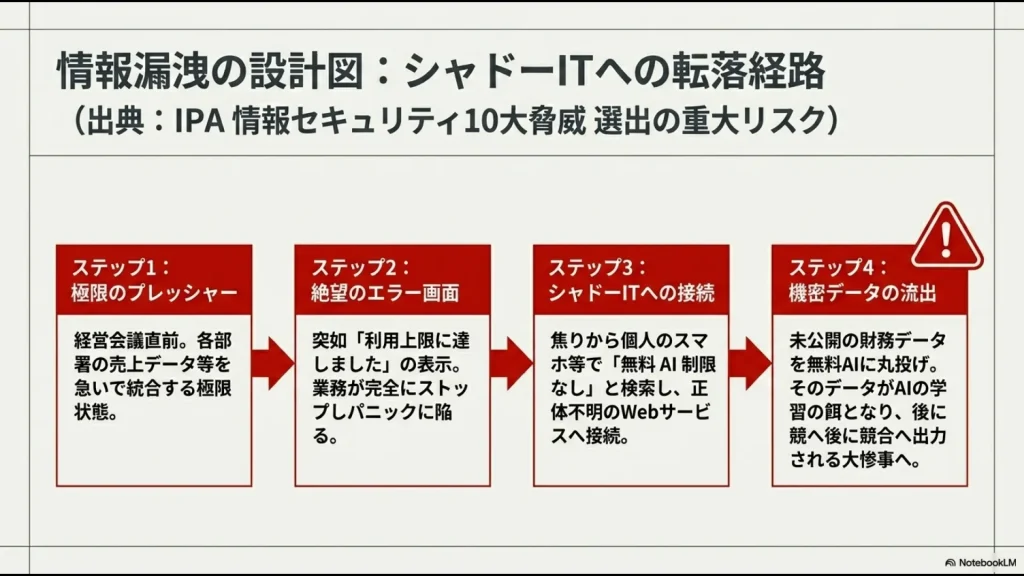

会議資料作成中の制限が招く情報漏洩

最も情報漏洩のリスクが高まる危険なタイミングが、経営会議や重要なクライアント向けのプレゼン資料を作成している「直前の時間帯」です。

明日の朝イチの会議に向けて、深夜に各部署から上がってきたバラバラの売上データや進捗レポートを急いで統合し、見栄えの良い要約を作らなければならない。

そんな極限のプレッシャーの中で『利用上限に達しました』というエラー画面が出た瞬間、現場の担当者はパニックに陥ります。

「この資料が間に合わなければ自分の評価が下がる、部署の責任になる」という強烈な焦燥感から、セキュアな社内環境を飛び出し、海外の怪しげな無料テキスト処理ツールに生データを丸投げしてしまうのです。

その生データの中には、取引先の詳細な社名や、まだ公開されていない新製品のプロジェクトコードが含まれているかもしれません。

本来、業務を助けるはずだったAIのシステム制限が、結果として社員を極限状態に追い込み、企業のコンプライアンスを根底から破壊する引き金になってしまう。

これは決して大げさなホラ話ではなく、管理部門の現場で今まさに起きているリアルな脅威なのです。

未公開財務データの流出リスク

バックオフィス業務を担う私たちが扱うデータの中で、最もセンシティブなのが財務データや人事評価などの未公開情報です。例えば、来期の予算編成やM&A(企業の合併・買収)に関する極秘のシミュレーションをAIに行わせていたとしましょう。

もし、制限を回避するために社員が利用した外部の無料AIツールが、「入力されたデータを今後のAIモデルの学習に利用する」という規約になっていたらどうなるでしょうか。

実は私の5歳の娘はとても慎重な性格で、遊ぶ前も準備を徹底し、少しでも危ないと思うことには絶対に手を出さないのですが、大人の私たちが仕事のプレッシャーに直面すると、その「当たり前の慎重さ」をいとも簡単に失ってしまうのが恐ろしいところです。

このような取り返しのつかない大惨事が起こり得ます。無料ツールの多くは、ユーザーからデータを収集することでサービスを維持しているため、機密情報を入力することは「自社の弱みを世界中に無料で公開している」のと同じ行為だと言っても過言ではありません。

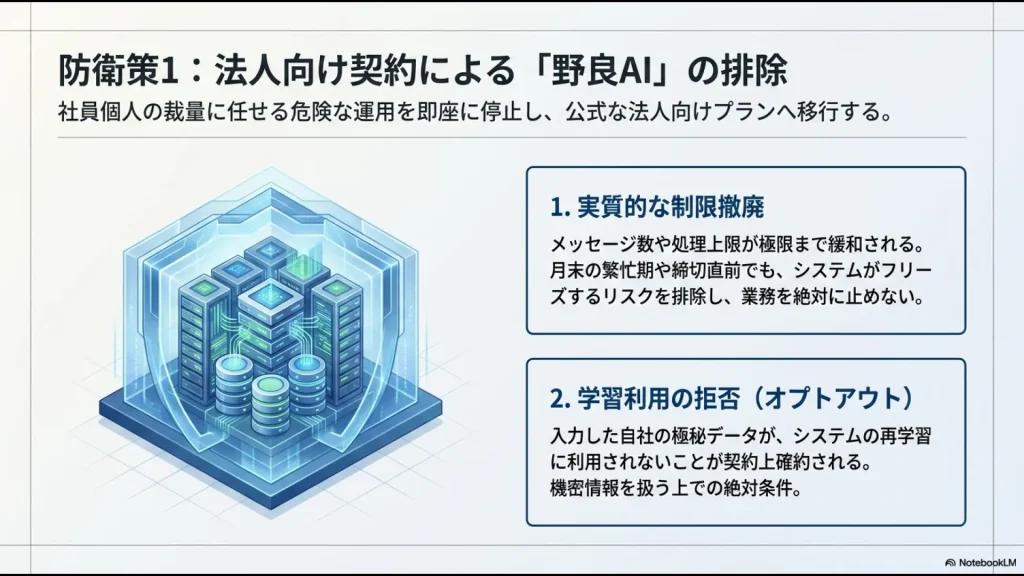

制限のない法人向けAIの導入

では、こうした恐ろしい事態を防ぐために、私たち企業側はどう対応すべきでしょうか。

一つの明確な答えは、社員が個人の裁量で無料版や安価な個人向けプランをかき集めて使う「野良AI運用」を直ちにやめ、会社として正式な法人向けプラン(Business、Pro、Enterprise等のビジネス版)を導入することですね。

法人向けの契約であれば、メッセージ数や処理トークンの上限が実質的に撤廃されたり、大幅に緩和されたりするため、月末の繁忙期でもAIがフリーズするリスクを極限まで抑え込むことができます。

さらに重要なのは、入力したデータがAIの再学習に利用されない(オプトアウト)という強固なセキュリティの確約が、契約上で担保されている点です。

目先のライセンス費用をケチった結果、数億円規模の損害賠償を伴う情報漏洩事故を起こしてしまっては本末転倒かなと思います。

特化型SaaSへの移行がプロの選択

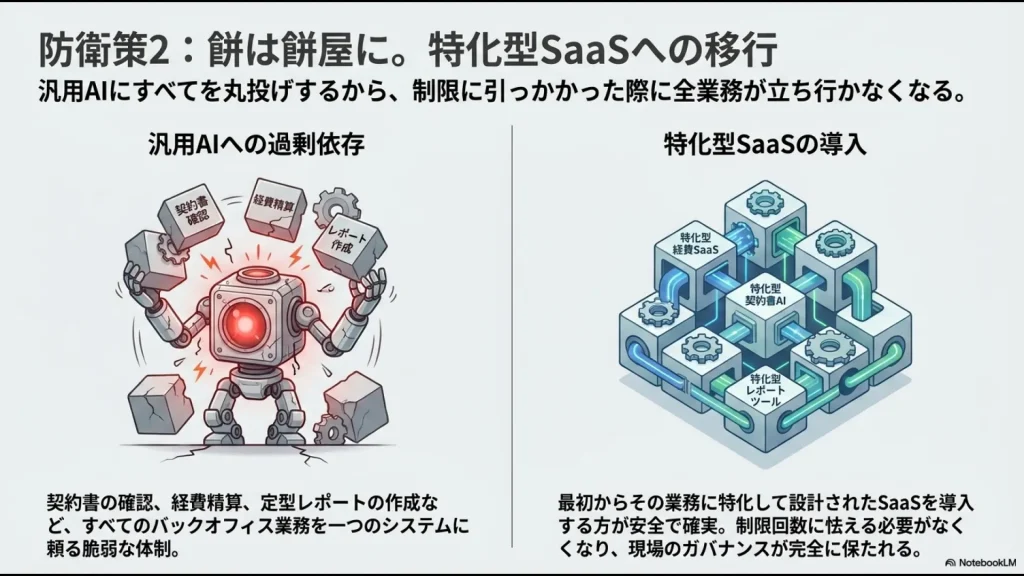

そして、元情シスとしてもう一つ強く推奨したい根本的な解決策が、汎用的な対話型AIへの「過度な依存」から脱却することです。

契約書のリーガルチェック、経費精算の自動化、日々の定型的なレポート作成といった基幹的なバックオフィス業務であれば、プロンプトを一生懸命工夫してAIにお願いするよりも、最初からその業務に特化して設計されたSaaS(クラウドサービス)へ移行する方がはるかに安全で確実です。

汎用AIにすべてを丸投げするから、システム制限に引っかかった時に業務が完全に立ち行かなくなるのです。

専門のSaaSであれば、裏側で高度なAIが動いていたとしても、ユーザーがいちいち「制限回数」を気にしてビクビクする必要はありません。

もし今の属人的な業務フローに限界を感じているなら、汎用AIに固執するのではなく、より現場のガバナンスに適したツールへの乗り換えを検討してみてください。

例えば、日々の煩雑なデータ入力や集計作業から脱却したいのであれば、私が厳選したバックオフィス向け脱エクセルツールの決定版などの専用アプリを活用するのが、現場の混乱を防ぐプロの選択ですね。餅は餅屋に任せるのが一番です。

GPT-5の制限を乗り越える業務最適化

今回は、最新AIツールのシステム的な壁が引き起こす現場のリアルな問題についてお話ししてきました。

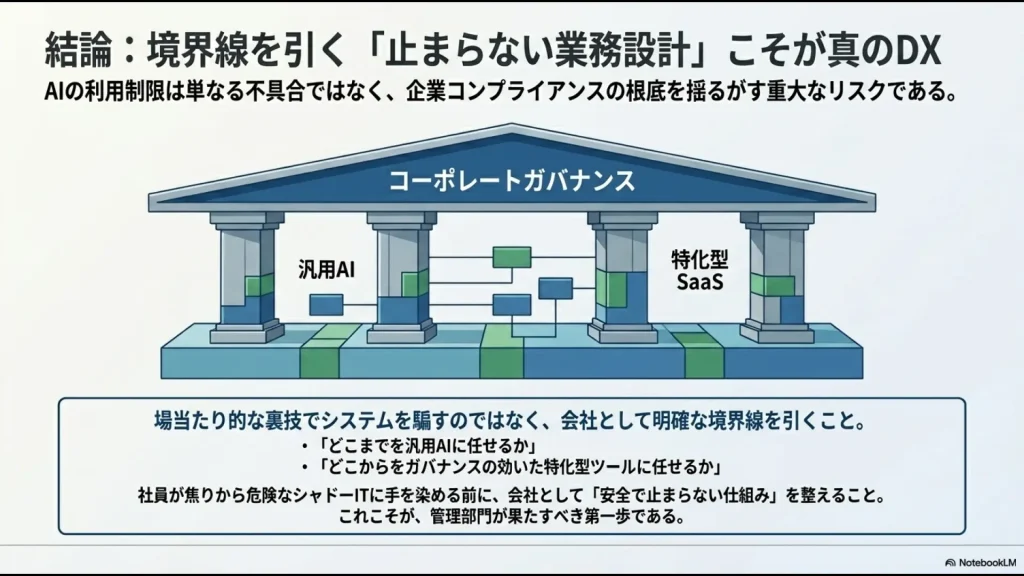

gpt 5 制限というキーワードの裏には、単なる「便利ツールの不具合」では済まされない、企業としての重大なコンプライアンスリスクが潜んでいます。

AIの利用回数や添付ファイルの容量上限に一喜一憂したり、キャッシュクリアなどの場当たり的な裏技でシステムを騙そうとしたりする運用は、百害あって一利なしです。

本当に業務を最適化したいのであれば、「どこまでを汎用AIに任せ、どこからをガバナンスの効いた特化型ツールに任せるか」という、明確な境界線を引く業務設計が必要不可欠かなと思います。

社員が焦りからシャドーITに手を染める前に、会社として安全で止まらない仕組みを整える。それが、私たち管理部門が果たすべき本当のDXの第一歩ですね。

AIの制限に振り回されて、現場の社員がシャドーITの危険を冒してしまう状況は、企業にとってまさに時限爆弾です。

「うちの会社は大丈夫だろうか…」と少しでも不安に感じた方は、新しいAIツールを探す前に、まずは会社として安全にデータを扱うためのルール(データガバナンス)の基礎を固めることを強くおすすめします。

「ガバナンスなんて難しそう…」と思うかもしれませんが、ITの専門知識がない管理部門の方でも、Udemyの『【ITの知識がなくても分かる!】データガバナンス入門~攻めのための守りとは~』を活用すれば、わずか数時間で「情報漏洩を防ぐための攻めと守りのルール作り」をサクッと学ぶことができます。

大きなセキュリティ事故が起きてからでは遅いです。

セール期間中であればランチ代程度の投資で、自社を致命的なリスクから守る一生モノの知識が手に入りますので、ぜひ一度チェックしてみてくださいね。

\ シャドーITを防ぐ!安全なルール作り /